Um Pouco de História Sobre Computadores...

A História dos computadores e da computação

Conheça os principais computadores usados desde a antiguidade até os dias de hoje.Hoje em dia, os computadores estão presentes em nossa vida de uma forma nunca vista anteriormente. Sejam em casa, na escola, na faculdade, na empresa, ou em qualquer outro lugar, eles estão sempre entre nós. Ao contrário do que parece, a computação não surgiu nos últimos anos ou décadas, mas sim há mais de 7 mil anos atrás.

Por este motivo, desenvolvemos este artigo, que conta a história e a evolução da computação e dos computadores em geral, desde a antiguidade até os dias de hoje. Desta maneira, você poderá ficar por dentro das principais formas de computação utilizadas pela humanidade. O texto está dividido em 4 partes e irá abordar temas diversos como ábaco: máquina de pascal, lógica de Boole, computadores mainframes, Steve Jobs, Bill Gates, entre vários outros.

Para começar, vamos falar sobre uma forma de calcular muito simples mas que também foi muito útil nas culturas antigas: o ábaco.

Ábaco, a primeira calculadora da história Muitos povos da antiguidade utilizavam o ábaco para a realização de cálculos do dia-a-dia, principalmente nas áreas de comercio de mercadorias e desenvolvimento de construções civis. Ele pode ser considerado como a primeira máquina desenvolvida para cálculo, pois utilizava um sistema bastante simples, mas também muito eficiente na resolução de problemas matemáticos. É basicamente um conjunto de varetas de forma paralela, que contém pequenas bolas que realizam a contagem.

Muitos povos da antiguidade utilizavam o ábaco para a realização de cálculos do dia-a-dia, principalmente nas áreas de comercio de mercadorias e desenvolvimento de construções civis. Ele pode ser considerado como a primeira máquina desenvolvida para cálculo, pois utilizava um sistema bastante simples, mas também muito eficiente na resolução de problemas matemáticos. É basicamente um conjunto de varetas de forma paralela, que contém pequenas bolas que realizam a contagem.

Seu primeiro registro é datado no ano de 5500 a.c., pelos povos que constituíam a Mesopotâmia. Contudo, o ábaco também foi usado posteriormente por muitas outras culturas: Babilônia, Egito, Grécia, Roma, Índia, China, Japão, etc. Cada um destes povos possui uma versão de específica desta máquina, entretanto, preservando a sua essência original. Seu nome roma antiga era "Calculus", termo de onde a palavra cálcuo foi derivada.

O fato deste instrumento ter sido difundido entre todas estas culturas se deve principalmente a dois fatores. O contato entre povos distintos é o primeiro deles, o que fez com que o ábaco fosse copiado de um lugar para vários outros no mundo. Por outro lado, a necessidade da representação matemática fez com os sistemas de contagens utilizados no cotidiano fossem implementados de forma mais prática.

Sobre as operações matemáticas, ele é bastante útil para a soma e subtração. Já a multiplicação e divisão, o ábaco comum não é muito recomendado, somente algumas versões mais complexas que padrão.

Régua de Cálculo

Durante vários séculos, o ábaco foi sendo desenvolvido e aperfeiçoado, sendo a principal ferramenta de cálculo por muito tempo. Entretanto, os principais intelectuais da época do renascimento necessitavam descobrir maneiras mais eficientes de efetuar cálculos. Logo, em 1638, depois de Cristo, um padre inglês chamado William Oughtred , criou uma tabela muito interessante para a realização de multiplicações muito grandes. A base de sua invenção foram as pesquisas sobre logaritmos, realizadas pelo escocês John Napier.

Até este momento, a multiplicação de números muito grandes era algo muito trabalhoso e demorado de ser realizado. Porém, Napier descobriu várias propriedades matemáticas interessantes e as deu o nome de logaritmos. Após, disso, multiplicar valores se tornou uma tarefa mais simples.

O mecanismo do William era consistido de um régua que já possuía uma boa quantidade de valores pré-calculados, organizados em forma que os resultados fossem acessados automaticamente. Uma espécie de ponteiro indicava o resultado do valor desejado.

Máquina de Pascal

Apesar da régua de cálculo de William Oughtred ser útil, os valores presentes nela ainda eram pre-definidos, o que não funcionaria para calcular números que não estivessem presentes na tábua. Pouco tempo depois, em 1642, o matemático francês Bleise Pascal desenvolveu o que pode ser chamado da primeira calculadora mecânica da história, a máquina de Pascal.

Seu funcionamento era baseado no uso de rodas interligadas, que giravam na realização dos cálculos. A ideia inicial de Pascal era desenvolver uma máquina que realizasse as quatro operações matemáticas básicas, o que não aconteceu na prática, pois ela era capaz apenas de somar e subtrair. Por esse motivo, ela não foi muito bem acolhida na época.

Alguns anos após a Máquina de Pascal, em 1672, o alemão Gottfried Leibnitz conseguiu o que pascal não tinha conseguido, criar uma calculadora que efetuava a soma e a divisão, além da raiz quadrada.

Baixaki:http://www.baixaki.com.br/tecnologia/1697-a-historia-dos-computadores-e-da-computacao.htm#ixzz1Dq4V3szE

O QUE É UM COMPUTADOR?

No dicionário encontramos: " Computador, s.m. - aquele que faz cômputos ou que calcula; máquina à base de circuitos electrónicos que efectua grandes operações e cálculos gerais, de maneira ultra rápida. " Os irónicos dizem: " Computador é o idiota mais veloz do mundo, pois fará qualquer coisa que nós lhe ordenarmos a uma velocidade extremamente alta. " Também podemos dizer: " Computador é um equipamento capaz de aceitar elementos relativos a um problema, submetê-lo a operações predeterminadas e chegar a um resultado. "

Complicado? Vamos estudar a história da criação do computador e poderemos ter a nossa própria definição sobre o computador...

PRIMEIRAS MÁQUINAS DE CALCULAR

PRIMEIRAS MÁQUINAS DE CALCULAR

A história do computador, ao contrário do que muitos podem imaginar, tem seu início há muito tempo atrás, desde quando o homem descobriu que somente com os dedos, ou com pedras e gravetos, já não eram suficientes para fazer cálculos...Então foi criado, há aproximadamente 5.000 a.C., um aparelho muito simples (fig. 1) formado por uma placa de argila onde se escreviam algarismos que auxiliavam nos cálculos. Esse aparelho era chamado de ÁBACO - palavra de origem Fenícia.

Cerca de 200 a.C., o Ábaco era constituído por uma moldura rectangular de

madeira com varetas paralelas e pedras deslizantes.

madeira com varetas paralelas e pedras deslizantes.O próximo passo na história dos computadores (ano de 1642), ocorreu quando um francês de 18 anos de nome Blaise Pascal, inventou a primeira máquina de somar: PASCALINA (fig. 2), a qual executava operações aritméticas quando se giravam os discos interligados, sendo assim a precursora das calculadoras mecânicas.

Por volta de 1671 na Alemanha, Gottfried Leibnitz inventou uma máquina muito parecida com a Pascalina (fig 3), que efectuava cálculos de multiplicação e divisão, e qual se tornou a antecessora directa das calculadoras manuais.

Por volta de 1671 na Alemanha, Gottfried Leibnitz inventou uma máquina muito parecida com a Pascalina (fig 3), que efectuava cálculos de multiplicação e divisão, e qual se tornou a antecessora directa das calculadoras manuais.

Em 1802 - na França, Joseph Marie Jacquard passou a utilizarCartões Perfurados para controlar suas máquinas de tear e automatizá-las.

Perfurados para controlar suas máquinas de tear e automatizá-las.

No início do século XIX, mais especificamente em 1822, foi desenvolvido por um cientista inglês chamado Charles Babbage uma máquina diferencial que permitia cálculos como funções trigonométricas e logaritmos, utilizando os cartões de Jacquard. Já em 1834, desenvolveu uma máquina analítica capaz de executar as quatro operações (somar, dividir, subtrair, multiplicar), armazenar dados em uma memória (de até 1.000 números de 50 dígitos) e imprimir resultados.

trigonométricas e logaritmos, utilizando os cartões de Jacquard. Já em 1834, desenvolveu uma máquina analítica capaz de executar as quatro operações (somar, dividir, subtrair, multiplicar), armazenar dados em uma memória (de até 1.000 números de 50 dígitos) e imprimir resultados.

Porém, sua máquina só pode ser concluída anos após a sua morte, tornando-se a base para a estrutura dos computadores actuais, fazendo com que Charles Babbage fosse considerado como o " Pai do Computador ".

O INÍCIO DA ERA DA COMPUTAÇÃO

Já no ano de 1890, época do censo dos EUA, Hermann Hollerith percebeu que só conseguiria terminar de apurar os dados do censo quando já seria o tempo de se efectuar novo censo (1900). Então aperfeiçoou os cartões perfurados (aqueles utilizados por Jacquard) e inventou máquinas (fig. 6) para manipulá-los, conseguindo com isso obter os resultados em tempo recorde, isto é, 3 anos depois.Em função dos resultados obtidos, Hollerith, em 1896, fundou uma companhia chamada TMC - Tabulation Machine Company,

vindo esta a se associar, em 1914 com duas outras pequenas empresas, formando a Computing Tabulation Recording Company vindo a se tornar, em 1924, a tão conhecida IBM - Internacional Business Machine.

vindo esta a se associar, em 1914 com duas outras pequenas empresas, formando a Computing Tabulation Recording Company vindo a se tornar, em 1924, a tão conhecida IBM - Internacional Business Machine.Em 1930, os cientistas começaram a progredir nas invenções de máquinas complexas, sendo que o Analisador Diferencial de Vannevar Bush anuncia a moderna era do computador. Em 1936, Allan Turing publica um artigo sobre " Números Computáveis " eClaude Shannon demonstra numa tese a conexão entre lógica simbólica e circuitos eléctricos. Em 1937, George Stibitz constrói em sua mesa de cozinha um " Contador Binário ".

Com a chegada da Segunda Guerra Mundial houve a necessidade de se projectar máquinas capazes de executar cálculos balísticos com rapidez e precisão para serem utilizadas na indústria bélica.

Com isso surgiu, em 1944, o primeiro computador electromecânico (construído naUniversidade de Harvard, pela equipe do professor H. Aiken e com a ajuda financeira da IBM, que investiu US$ 500.000,00 no projecto), possuía o nome de MARK I, era controlado por programa e usava o sistema decimal. Tinha cerca de 15 metros de comprimento e 2,5 metros de altura, era envolvido por uma caixa de vidro e de aço inoxidável brilhante e possuía as seguintes características:

metros de altura, era envolvido por uma caixa de vidro e de aço inoxidável brilhante e possuía as seguintes características:

- 760.000 peças,800 km de fios,

- 420 interruptores para controle

- realizava uma soma em 0,3 s

- realizava uma multiplicação em 0,4 s

- e uma divisão em cerca de 10 s

Os computadores Z3 e logo a seguir o Z4, eram utilizados na solução de problemas de engenharia de aeronaves e projectos de mísseis, sendo que Zuze também construiu vários outros computadores para fins especiais, mas não teve muito apoio do governo Alemão, pois Hitler, na época mandou embargar todas as pesquisas científicas, excepto as de curto prazo, sendo que o projecto de Zuze levaria cerca de 2 anos para ser concluído. Umas das principais aplicações da máquinas de Zuze era quebrar os códigos secretos que os ingleses usavam para se comunicar com os comandantes no campo.

COMPUTADORES DE QUINTA GERAÇÃO

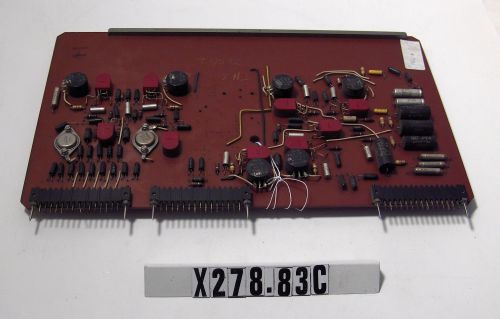

Os computadores de Quinta Geração têm como característica o uso de ICVLSI - Integrated Circuit Very Large Scale Integration, ou seja, " Circuitos Integrados em uma Escala Muito Maior de Integração ".

Os computadores de Quinta Geração têm como característica o uso de ICVLSI - Integrated Circuit Very Large Scale Integration, ou seja, " Circuitos Integrados em uma Escala Muito Maior de Integração ".

Os " chips " vêm diminuídos tanto de tamanho, fazendo com que seja possível a criação de computadores cada vez mais compactos, como é o caso da micro miniaturização do microprocessador F-100, que mede somente 0,6 cm quadrados e é pequeno o suficiente para passar pelo buraco de uma agulha!

CLASSIFICAÇÃO DOS COMPUTADORES

Inicialmente, os computadores eram agrupados em dois tipos:

- Pessoal: caracterizavam-se pela limitação de recursos de periféricos, pela não conexão com outros equipamentos e pela baixa velocidade de transmissão de dados.

- Profissional: permitiam a expansão de periféricos à sua configuração básica, maior velocidade de transmissão e a conexão a outros equipamentos.

Podiam também serem classificados quanto às características de utilização:

- Científicos: que possuem uma pequena entrada de dados; um processamento complexo, com grandes rotinas de cálculos e uma pequena saída de resultados.

- Comerciais: que possuem uma grande entrada de dados; um processamento relativamente simples e uma grande saída de resultados.

Ou, quanto às características de operação:

- Analógicos: computadores que executam trabalhos usando elementos representados por grandezas físicas, como por exemplo, a intensidade de uma corrente eléctrica ou o ângulo de giro de uma engrenagem. São computadores criados para uma finalidade específica, isto é, só se aplicam a um determinado trabalho. Os resultados obtidos com o uso de computadores analógicos são aproximados e servem ao próprio sistema onde é utilizado, como por exemplo: controle de temperatura de uma caldeira utilizando sensores, medidor de água ou de energia eléctrica.

- Digitais: computadores que realizam suas operações utilizando elementos representados por grandezas matemáticas (números), ou seja, operam dígito a dígito. São computadores destinados a aplicações múltiplas, podendo ser utilizados em diversas tarefas. Por utilizar valores numéricos, os resultados obtidos com esse tipo de computador são exactos, como por exemplo: os cálculos de engenharia.

(O computador analógico " mede " e o computador digital " conta ")

TIPOS DE COMPUTADORES PADRÃO PC

Existem vários tipos de computadores:

"Mainframes ", que são computadores de grande ou médio porte, utilizados em grandes empresas;

Minicomputadores;

Microcomputadores, também conhecidos como " desktop ", os quais existem de diversos modelos e tipos, como PC, Macintosh e Power PC;

Portáteis, como os laptops, notebooks, mini-notebooks, handhelds, notepads e palm tops.

O IBM PC, ou Personal Computer (Computador Pessoal), surgiu em 1981 e se tornou um padrão de microcomputador, o qual passou a ter uma evolução muito rápida, e difícil de se acompanhar...

pois ao adquirimos um modelo que consideramos de último tipo, verificamos que já despontou no mercado um outro mais novo, mais moderno e poderoso!

Vejamos se conseguimos " acompanhar " um pouco desta acelerada evolução:

PC - Personal Computer:

permitia a inclusão de 5 placas de expansão;

256 Kb de memória RAM

40 Kb memória ROM

uma ou duas unidades de disquete de 5 1/4 " com capacidade de gravação de 360 Kb;

monitor CGA monocromático (fósforo verde, âmbar ou branco).

PC XT - PERSONAL COMPUTER EXTENDED TECNOLOGY:permitia a inclusão de 8 placas de expansão; | PC AT - PERSONAL COMPUTER ADVANCED TECNOLOGY:permitia a inclusão de 8 placas de expansão; |

AT 286de 7 a 16 MHz; | 386 SXgeralmente de 16 a 20 MHz; |

386 DXgeralmente de 33 a 40 MHz; | 486 SLC, DLC OU SXgeralmente de 25 a 40 MHz; |

486 DXgeralmente de 40 a 50 MHz; | 486 DX2geralmente de 66 MHz; |

486 DX4de 80 a 100 MHz; | 586 (COM PROCESSADOR CYRIX OU AMD) OU PENTIUM (PROCESSADOR INTEL)de 75 a 200 MHz; |

686 (COM PROCESSADOR CYRIX)(não teve muita aceitação); | PENTIUM PRO(foi muito utilizado na área gráfica) |

PENTIUM MMXcom tecnologia MMX que acelera os gráficos em 3 D; | PENTIUM IIcom tecnologia MMX que acelera os gráficos em 3 D; |

PENTIUM II CELERON (INTEL) OU K6 - II (AMD)processador socket 7; | PENTIUM III (INTEL) OU K-7 (AMD DURON)processador slot 1; |

IMPORTANTE: as configurações acima são básicas, podendo variar de acordo com o fabricante.

HARDWARE E SOFTWARE

Você conhece o significado de " Hardware " e " Software "?

Hardware: é o nome dado ao conjunto de dispositivos (componente físicos) que formam o computador, isto é, a máquina propriamente dita.

Software: é o nome dado aos programas de um computador, ou seja, o conjunto ordenado de instruções, expresso em linguagens especiais e compreensíveis para a máquina, para que ela possa executar as operações que desejamos.

A EVOLUÇÃO DOS SISTEMAS OPERACIONAIS

O Sistema Operacional é um conjunto de programas que permitem a criação e manutenção de arquivos, execução de programas e utilização de periféricos tais como: teclado, vídeo, unidades de disquete, impressora. O Sistema Operacional serve também de intermediário entre os aplicativos e o computador, pois é ele que coloca os programas na memória para que sejam executados.

Vamos ver, então, um pouco da história dos Sistemas Operacionais para microcomputadores padrão IBM PC:

MS-DOS 1.0 e PC-DOS 1.0: Em 1981 surgiram os dois primeiros DOS, ou seja, " Disk Operating System " (Sistema Operacional de Disco).

MS-DOS 1.25 e PC-DOS 1.1: Nesta versão, foram acrescentados suporte a discos de dupla face e correcção de " bugs "; foram amplamente distribuídos por OEMs além da IBM.

MS-DOS 2.0 e PC-DOS 2.0: Foram lançados em 1983, juntamente com o IBM PC/XT e nesta versão foram acrescentados suporte aos discos rígidos e à estrutura hierárquica de arquivos semelhante aos do UNIX / XENIX.

PC-DOS 2.1: Lançado com o PCjr e com correcção de " bugs ".

MS-DOS 2.01: Versão lançada com suporte internacional.

MS-DOS 2.11: Somente com correcção de " bugs ".

MS-DOS 2.25: Veio com suporte ao conjunto de caracteres estendidos.

MS-DOS 3.0 e PC-DOS 3.0: Lançados em 1984 juntamente com o PC/AT e foram acrescentados o suporte a discos flexíveis de 1.2 Mb e a discos rígidos maiores.

MS-DOS 3.1 e PC-DOS 3.1: Nesta versão foi acrescentado o suporte às redes da Microsoft.

WINDOWS 1.0: Em 1985, foi lançado o Windows, que na realidade não era um sistema operacional, mas somente uma interface gráfica com o usuário do MS-DOS, ou seja, para que o Windows funcionasse, havia a necessidade de se carregar previamente o MS-DOS.

MS-DOS 3.2 e PC-DOS 3.2: Em 1986, tiveram acrescentado o suporte a discos de 3,5 polegadas.

MS-DOS 3.3 e PC-DOS 3.3: Em 1987, foram lançados juntamente com o PS/2 da IBM e possuíam amplo suporte a páginas de código fonte.

WINDOWS 2.0: Apareceu, também em 1987, mas com compatibilidade com o OS/2 Presentation Manager.

MS-DOS 4.0 e PC-DOS 4.0: Lançado em 1988, com suporte a volumes lógicos maiores do que 32 Mb; " shell " visual.

MS-DOS 5.0: Lançado em 1989, com alguns recursos a mais.

MS-DOS 5.2: Com correcção de bugs.

WINDOWS 3.0: Surgiu em 1990, para ser utilizado em computadores 286 e 386 e foi lançado em grande estilo, mas ainda não teve grande aceitação.

MS-DOS 6.0: Em 1993, possuía recursos para verificação do winchester e desfragmentação (Defrag).

WINDOWS 3.1: Passou a ser mais conhecido e aceito.

MS-DOS 6.2: Última versão do MS-DOS lançada, tinha correcção de " bugs ".

WINDOWS 3.11 For Workgroups: Versão para ligação de computadores em rede, passou a ser utilizado pela grande maioria de usuários de microcomputadores.

WINDOWS 95: Em 1995, o Windows tornou-se verdadeiramente um Sistema Operacional, funcionando sozinho, sem a necessidade do MS-DOS. Foi quando o seu sucesso estourou.

WINDOWS NT: Sistema Operacional para Servidores de Rede.

WINDOWS 95 SE (Second Edition): Versão lançada para correcção de bugs.

WINDOWS 98: Versão de aperfeiçoamento da versão 95, mas com uma novidade: passa a ser um aplicativo 32 bits.

WINDOWS 98 SE (Second Edition): Versão com correcção de bugs.

WINDOWS 2000: Lançado em 2000, com correcção de bugs, e suporte a redes, na realidade uma actualização do Windows NT.

CÓDIGO DE MÁQUINA

A linguagem do computador, também chamada de código de máquina, é composto somente de dois números: 0 e 1. E com

SISTEMA DECIMAL (BASE 10)

SISTEMA BINÁRIO (BASE 2)

milhar

103centena

102dezena

101unidade

100milhar

23centena

22dezena

21unidade

205

7

9

2

1

0

1

0

2 x 1 =2

9 x 101 =90

7 x 102 =700

5 x 103 = 5000Valor =5792

0 x 20 = 0

1 x 21 = 2

0 x 22 = 0

1 x 23 = 8Valor = 10

estes dois números, é possível escrever absolutamente tudo. Os códigos 0 e 1 são também chamados de sistema binário, e significam para o computador: 0 = desligado e 1 = ligado. A união de 8 conjunto de " zeros " e " uns " formam um carácter qualquer como por exemplo a letra " A ": 1010 0001.

Veja na tabela à direita, uma comparação do Sistema Binário com o Sistema Decimal (que é o normalmente utilizado pelas pessoas):

Se você quiser saber quais os códigos binários que são necessários para escrever o seu nome, ou uma palavra qualquer, dê uma olhada na tabela em baixo:

CarácterCódigo ASCICarácterCódigo ASCI(espaço)

.

(

+

$

*

)

-

/

'

,

=

A

B

C

D

E

F

G

H

I

J

K

L0100 0000

0100 1110

0100 1000

0100 1011

0100 0100

0100 1010

0100 1001

0100 1101

0100 1111

0100 1100

0100 0111

0101 1101

1010 0001

1010 0010

1010 0011

1010 0100

1010 0101

1010 0110

1010 0111

1010 1000

1010 1001

1010 1010

1010 1011

1010 1100M

N

O

P

Q

R

S

T

U

V

W

X

Y

Z

0

1

2

3

4

5

6

7

8

91010 1101

1010 1110

1010 1111

1011 0000

1011 0001

1011 0010

1011 0011

1011 0100

1011 0101

1011 0111

1011 0111

1011 1000

1011 1001

1011 1010

0101 0000

0101 0001

0101 0010

0101 0011

0101 0100

0101 0101

0101 0110

0101 0111

0101 1000

0101 1001BITS & BYTES

Bit - é a menor unidade de dado do computador, podendo assumir um dos dois valores 0 ou 1, sendo que, se o nível de energia for baixo assumido é 0 e se o nível de energia for alto o valor assumido é 1. Se desejarmos representar números maiores, deveremos cominar bits em palavras.

Byte - é um conjunto de 8 bits, formando segundo uma sequência que representa um carácter. Pode-se fazer uma correspondência biunívoca entre cada número decimal (0 a 9), as letras maiúsculas e minúsculas (A até Z), os símbolos matemáticos, a pontuação, etc, com um respectivo byte.

Kilobyte ou Kbyte ou Kb - um Kbyte corresponde a 210 bytes ou seja, 1024 bytes. Ex.: um microcomputador antigo tipo PC-XT possuía 640 Kbytes de memória, ou seja, 655.360 bytes de memória, porque: 640 Kb x 1024 bytes = 655.360 bytes. Isto quer dizer que ele poderia ter na sua memória até 655.360 caracteres.

Megabyte ou Mbyte ou Mb - um Mbyte corresponde a 1024 Kbytes, 1.048.576 bytes.

Gigabyte ou Gbyte ou Gb - um Gbyte corresponde a 1024 Mbytes.

Terabyte ou Tbyte ou Tb - um Tbyte corresponde a 1024 Gbytes.LINGUAGENS DE COMPUTAÇÃO

São programas utilizados para criar sistemas e softwares aplicativos e podem ser de 2 tipos:

- Linguagens de Baixo Nível: que são linguagens totalmente orientadas para a máquina, ou seja, são as que mais se aproximam do " Código de Máquina ", ou seja, dos 0 e 1, e há a necessidade de se conhecer solidamente o hardware. Os programas resultantes destas linguagens são de pequeníssimo tamanho e de extrema rapidez. Exemplo: Assembler, Linguagem C.

- Linguagens de Alto Nível: é uma linguagem mais orientada para o problema, de modo que o programador deve dar pouca ou nenhuma atenção às características do computador que irá executar o programa. Os programas resultantes destas linguagens não são tão rápidos. Exemplo: Delphi, Visual Basic, Pascal, o antigo Clipper, etc.

Para que os programas funcionem, eles necessitam ser traduzidos para o código de máquina (ou seja o código fonte do programa deve ser transformado em código objecto) e para isso precisa de um tradutor ou de um compilador:

- Tradutor: deve estar na memória enquanto se executa o programa; o programa precisa ser traduzido cada vez que é rodado; cada instrução vai sendo traduzida a medida que vai sendo executada, com isso o programa acaba por se tornar mais lento. Exemplo: Access, DBase, etc.

- Compilador: não precisa estar na memória enquanto se executa o programa, pois este é traduzido inteiramente uma vez só, tornando sua execução bem mais rápida. Exemplo: Delphi, Clipper, Pascal, C, etc.

TIPOS DE SOFTWARE

Existe uma quantidade muito diversificada de softwares disponíveis no mercado. Entre os tipos mais conhecidos estão:

Sistemas Operacionais: Controlam o computador (sem eles, o computador não funciona). Exemplo: MS-DOS, Windows, OS/2, Unix, etc.

Editores de Texto: Substituem, com muitíssimas vantagens, a máquina de escrever, podendo-se fazer textos, memorandos, cartas, contratos, relatórios, correspondências em geral, documentos, etc. Num Editor de Textos, podem ser utilizados diversos recursos, tais como: sublinhado, negrito, fontes de letras de diversos tipos, cores, correcção ortográfica, inserção de textos, etc. Exemplo: Word, WordPerfect, Lotus AmiPro, etc.

Planilhas de Cálculo: Servem para se fazer todos os tipos de cálculos e operações matemáticas, sendo bastante úteis para diversas aplicações, tais como: folha de pagamento, contabilidade, contas a pagar e a receber, cálculos estatísticos, balanços, criações de gráficos, etc. Exemplo: Excel, Lotus 123, etc.

Gestionário de Base de Dados: Os quais serem para armazenar informações, tais como, cadastro de clientes, fornecedores, materiais, peças, mala-diretas, etc. Podendo ser efectuados cálculos e emitidos relatórios, com grande facilidade. Exemplo: Access, DBase, Paradox, etc.

Programas Gráficos - CAD: Os CAD - Computer Aided Design ou seja, programas de projectos assistidos por computador que são muito utilizados por arquitectos, engenheiros, desenhistas, ilustradores, etc. e servem para se criar desenhos, imagens, alterar fotografias. Exemplo: Auto-CAD, etc.

Editores Gráficos: Servem para se criar desenhos, imagens, alterar fotografias. Exemplo: Corel Photo Paint, Paint Shop Pro, Ulead Photo Impact, etc.

Programas de Edição Gráfica: São programas para unir imagens e textos, na criação de apresentação gráfica: folhetos, panfletos, cartões de visita, cartões de cumprimento, cartões postais, etiquetas, textos para jornais, etc. Exemplo: Corel Draw, Page Maker, MS-Publisher, etc.

Integrados : Servem para os usuários que necessitam trabalhar com diversos softwares ao mesmo tempo (planilha, editore de texto, banco de dados, gráficos), porém possuem menores recursos do que os softwares adquiridos isoladamente. Exemplo: MS-Works, StarOffice, etc.

Programas Educacionais : São de diversos tipos, desde programas educacionais para crianças, quanto cursos de línguas, tradutores, enciclopédias, dicionários, etc.

Programas de Jogos : Servem para divertir crianças e adultos, e existem vários e de diversos tipos, desde bem simples até muito complexos, incluindo imagens em 3 dimensões. Exemplo: Paciência, Come-come, Doom, Prince of Persia, Simuladores de Submarino, de Avião, de Helicóptero, Corridas de Formula 1, etc.

Browsers : São programas que servem para a navegação na Internet. Exemplo: Internet Explorer, FireFox, Netscape Navigator, Opera, etc.

A HISTÓRIA DE YAHOO!

Fevereiro de 1994, dois estudantes de Stanford, Jerry Yang e David Filo editaram " Jerry e David's Guide to the World Wide Web ". Um site onde eles disponibilizavam seus favoritos Internet (bookmarks), classificados em várias categorias. A ideia de uma forma mais abrangente desse guia vem dois meses depois. Yahoo, que era então uma iniciativa privada, acaba por ser fundada oficialmente em 2 de Março de 1995.

Fevereiro de 1994, dois estudantes de Stanford, Jerry Yang e David Filo editaram " Jerry e David's Guide to the World Wide Web ". Um site onde eles disponibilizavam seus favoritos Internet (bookmarks), classificados em várias categorias. A ideia de uma forma mais abrangente desse guia vem dois meses depois. Yahoo, que era então uma iniciativa privada, acaba por ser fundada oficialmente em 2 de Março de 1995.

A história de Yahoo começa então com um anuário de referenciamento de mais de 30.000 sites em 19 categorias diferentes. Jerry e David são mais ambiciosos, mas para realizar suas ambições alguns fundos eram necessários. Tim Brady, um amigo de Jerry no segundo ano de Harvard Business School, que era responsável pela elaboração de um plano de negócios de Sequoia Capital ficou seduzido pelo projecto, e rapidamente financiou Yahoo a um limite de 4 milhões de dólares.

O primeiro artigo do Yahoo News foi publicado no domingo, 12 de Março de 1995 no San Jose Mercury News. Naquela época, o site já indexava uma média de 100 endereços por dia. O link indicado no artigo apontava para o servidor da Universidade de Stanford, cuja rede teve dificuldades para hospedar um site já tão popular.

época, o site já indexava uma média de 100 endereços por dia. O link indicado no artigo apontava para o servidor da Universidade de Stanford, cuja rede teve dificuldades para hospedar um site já tão popular.

Uma vez incorporados os fundos angariados e a crescente reputação, os empregados fizeram sua primeira entrada no futuro heavyweight web. Após os dois fundadores, Tim Brady - um amigo de Jerry Yang, que escreveu o plano de negócios da empresa - é o primeiro funcionário da Yahoo, o que deixou em 2002. Siga Donald Lobo, contratada para desenvolver o site, Srinija Srinivasan, o editor do anuário e CEO Tim Koogle, um antigo Motorola iriam lançar o " start-up ".

Desde o Verão de 1994, o site do Jerry Yang e David Filo hospeda mais de 10.000 visitantes por dia. Naquela época, o número de utilizadores da Internet a nível mundial era inferior a 40 milhões. Yahoo era o local ideal para a orientação sobre a Web, e os webmasters corriam para indexar seus sites no Yahoo que aumentava de forma colossal o numero de aderentes Yahoo integrava um espaço de publicidade na sua home page na primeira versão do site. Depois criou as bases para o livre modelo baseado exclusivamente sobre os rendimentos provenientes da publicidade. Um modelo original que demonstrava a sua relevância muito rapidamente: Yahoo entra na Nasdaq em Março de 1996 e gera mais de 19 milhões de dólares em vendas nesse ano.

Yahoo integrava um espaço de publicidade na sua home page na primeira versão do site. Depois criou as bases para o livre modelo baseado exclusivamente sobre os rendimentos provenientes da publicidade. Um modelo original que demonstrava a sua relevância muito rapidamente: Yahoo entra na Nasdaq em Março de 1996 e gera mais de 19 milhões de dólares em vendas nesse ano.

Logo, o Yahoo se torna uma referência. O site, a marca de exclamação ponto tornar-se o símbolo da Internet junto do grande público. Yahoo adquire uma forte simpatia e se tornou a figura da " nova economia ", um relançamento da economia, em oposição a uma economia " doce ". Esta distinção tem também implicações sobre a gestão para os excessos de funky negócio.

início, mas está crescendo rápido. O líder vagas são tomadas, deve prevalecer, e rapidamente. Yahoo está investindo pesadamente em suas campanhas publicitárias para fazer " Do You Yahoo? " um gancho no mundo conhecido.HISTÓRIA DA INTERNET

Em 1969, em plena guerra fria, o governo americano, ciente da importância dos computadores e de sua interligação em uma guerra mundial, encomendou um projecto de uma rede híbrida de computadores que permitisse, mesmo sob um bombardeio, comunicação rápida, eficiente e ainda oferecesse rotas alternativas.

A criação desta rede ficou sob a responsabilidade da ARPA (Advanced Research Projects Agency). Chamada de ARPAnet, esta rede interligava alguns laboratórios de pesquisa. Em 1972 a ARPAnet já contava com 40 computadores interligados e em 1973 foi efectuada a primeira conexão internacional, com a Inglaterra e a Noruega.

Em 1975 a ARPAnet deixa de ser uma rede experimental para ser uma rede operacional. Neste mesmo momento, iniciou-se o desenvolvimento do protocolo de comunicação TCP/IP.

Em 1983 três fatos importantes aconteceram: Primeiro, o protocolo TCP/IP é adoptado como um padrão para as redes militares. Em segundo lugar, iniciou-se o desenvolvimento do Berkeley UNIX (BSD). E finalmente, ARPAnet é dividida em duas redes. Uma, denominada MILNET, que passa a fazer parte da Defense Data Network (DDN) e uma nova ARPANET. Então, o termo Internet (inter-redes) foi usado para referenciar as duas redes.

A partir deste momento, a tecnologia da ARPAnet (Internet) passou a ser usada para conectar universidades e laboratórios de pesquisa nos EUA e em diversos outros países.

Num primeiro momento a Internet oferecia serviços básicos como, por exemplo, correio electrónico, telnet, ftp e finger.

Em 1987, com a liberação, nos EUA, do uso comercial da Internet e a partir de 1989 com o desenvolvimento do WWW (World Wide Web), pelo CERN - um laboratório de física de partículas localizado na Suíça - houve um aumento significativo do número de hosts e usuários conectados na " grande rede ". Porém, o crescimento vertiginoso aconteceu a partir de 1993 com desenvolvimento do programa Mosaic, navegador WWW que permitiu o acesso ao Web em um ambiente gráfico. Actualmente, estima-se que existam mais de 9 milhões de computadores e mais de 70 milhões de usuários da Internet em todo o mundo.

A primeira espinha dorsal (backbone) da Internet no Brasil foi montada em 1992, através da RNP - Rede Nacional de Pesquisa (criada dois anos antes). Este backbone interligava as principais universidades e centros de pesquisa do país, além de algumas organizações não-governamentais. Em 1995 foi liberado o uso comercial da Internet no Brasil.

A Internet é uma rede capaz de interligar todos os computadores do mundo. O que faz a Internet tão poderosa assim é uma espécie de esperanto da informática que atende pelas siglas TCP/IP (Protocolo de Controle de Transferência/Protocolo Internet, em inglês). Todos os computadores que entendem essa língua são capazes de trocar informações entre si. Assim pode-se conectar máquinas de diferentes tipos, como PCs, Macs e Unix.

A Internet é organizada na forma de uma malha. Se você pretende aceder um computador no Japão, por exemplo, não é necessário fazer um interurbano internacional. Basta conectar-se a um computador ligado à Internet na sua cidade. Esse computador local está conectado a uma máquina em outro estado (ou país) e assim por diante, traçando uma rota até chegar ao destino. São máquinas de alta capacidade, com grande poder de processamento e conexões velozes, conhecidas como servidores, controladas por universidades, empresas e órgãos do governo.

Essa forma de funcionamento garante um custo baixo de conexão. Você só precisa pagar a ligação local até o seu fornecedor de acesso. Essa empresa (ou instituição) cobra taxa mensal de cada usuário para cobrir, entre outros, os custos da conexão com a rede. Mesmo assim, você paga o mesmo preço se enviar uma mensagem para o Japão ou para seu vizinho.

Além de ficarem conectados entre si, os servidores Internet têm outras funções. A mais comum é fornecer acesso. Instituições académicas permitem a funcionários, professores e alunos se conectarem à rede através de computadores instalados no campus ou de casa, pela linha telefónica. As grandes empresas oferecem acesso à Internet a seus funcionários por meio de suas próprias redes internas. Por fim, existem empresas especializadas em vender conexão à rede.

Os servidores Internet podem oferecer vários serviços. Copiar arquivos, enviar mensagens para outros usuários, participar de grupos de discussão e visitar serviços de informação são os principais:

- Web

O principal serviço da Internet é a Web, a parte multimédia da rede. É na Web que você pode ler jornais electrónicos, fazer compras em shoppings virtuais e consultar bancos de dados. É possível ainda saltar de um lugar a outro na Internet por meio de páginas interligadas. A quantidade e diversidade do conteúdo colocado na Web é tão grande que é preciso utilizar serviços de catalogação para encontrar as informações que você está procurando. Clique aqui para saber mais sobre a Web. - Correio electrónico

Com o correio electrónico, pode-se enviar mensagens para qualquer usuário da rede. O texto chega ao destino em alguns minutos (ou horas, dependendo do tráfego) e o usuário não precisa estar conectado para receber a carta. A mensagem fica armazenada em uma caixa postal electrónica até que o destinatário resolva abrir o envelope digital. As vantagens sobre o fax são muitas. Você pode armazenar em seu computador todas as mensagens enviadas e recebidas pelo tempo que quiser. É possível também copiar trechos dos textos que escrevem para você e comentá-los na sua resposta. Clique aqui para saber mais sobre o e-mail. - Transferência de arquivos

Com o FTP é possível copiar programas gratuitos de servidores da rede. A maioria destes servidores está localizada em universidades e contém todos os tipos de software. - Grupos de discussão

A Internet é uma grande comunidade virtual. Como toda comunidade, tem clubes que reúnem pessoas com interesses semelhantes. Na rede, esses clubes são chamados de grupos de discussão e podem acontecer de duas formas. Existem os grupos da Usenet, que funcionam como quadros de avisos divididos por assunto, e os canais de chat, onde os usuários podem bater papos ao vivo em salas especiais para cada tópico. Na Usenet, você pode entrar no grupo dos fãs do seriado Os Simpsons, ler as mensagens dos demais usuários e enviar suas próprias contribuições. Existem mais de 16 mil grupos na Usenet, com assuntos tão diversos como nano tecnologia e patins in-line. Clique aqui para saber mais sobre a Usenet. Os canais de chat permitem que vários usuários conversem ao mesmo tempo através de frases digitadas no teclado. As conversas são organizadas em salas virtuais, que podem ou não ser dedicadas a um determinado assunto.

Os primeiros computadores da década de 1940 possuíam somente dois níveis de linguagem de programação: o nível da linguagem de máquina, no qual toda a programação era feita, e o nível da lógica digital, onde os programas eram efetivamente executados. Com Wilkes, em 1951, surgiu a ideía de se projetar um computador a três níveis, a fim de se simplificar o hardware. Esta máquina tinha um programa denominado interpretador armazenado permanentemente, cuja função era executar os programas em linguagem de máquina. O hardware assim poderia ser simplificado: teria apenas que executar um pequeno conjunto de microinstruções armazenadas, ao invés de todo o programa em linguagem de máquina, o que exigia menos circuitos eletrônicos. A partir daí começam a evoluir as linguagens e as arquiteturas das máquinas, impulsionadas, principalmente, pelo aparecimento de um novo conceito na História da Computação: os Sistemas Operacionais.

Da segunda geração de computadores aos dias de hoje

A segunda geração (1956 - 1963) foi impulsionada pela invenção do transistor (1948) e em 1956 já se produziam computadores com esta tecnologia. Apareceram também os modernos dispositivos, tais como as impressoras, as fitas magnéticas, os discos para armazenamento, etc. Os computadores passaram a ter um desenvolvimento rápido, impulsionados principalmente por dois fatores essenciais: os sistemas operacionais e as linguagens de programação.Os circuitos integrados propiciaram um novo avanço e com eles surgiram os computadores de terceira geração (1964 - 1970). As tecnologias LSI, VLSI e ULSI abrigam milhões de componentes eletrônicos em um pequeno espaço ou chip, iniciando a quarta geração, que vem até os dias de hoje. Os atuais avanços em pesquisa e o projeto de novas tecnologias para os computadores estão possibilitando o surgimento da quinta geração. Dois avanços que configuram um divisor de águas são o processamento paralelo, que quebrou o paradigma de von Neumann, e a tecnologia dos supercondutores.

Arquiteturas de computadores e sistemas operacionais

O termo arquitetura de computador vem da possibilidade de se visualizar uma máquina como um conjunto hierárquico de níveis que permite entender como os computadores estão organizados. Os primeiros computadores digitais por exemplo somente possuiam dois níveis. O primeiro é chamado o nível da lógica digital, formado no início por válvulas e depois por transistores, circuitos integrados, etc. O segundo é chamado de nível 1, também chamado de nível de microprograma, que é o nível da linguagem da máquina, onde toda a programação era feita, através de zeros e uns, e que posteriormente seria o responsável por interpretar as instruções do nível 2.

Com Maurice Wilkes em 1951 surgiu outro nível, onde as instruções eram escritas de um modo mais conveniente para o entendimento humano: a técnica consistia em substituir cada instrução desse novo nível por um conjunto de instruções do nível anterior (nível da máquina) ou examinar uma instrução de cada vez e executar a sequência de instruções equivalentes do nível da máquina. Denominam-se estes procedimentos por tradução e interpretação. Isto simplificou o hardware que agora somente tinha um conjunto mínimo de instruções e portanto menos circuitos eram necessários.

A partir daí a evolução do hardware avança juntamente com as novas descobertas científicas: quase na mesma época do aparecimento dos transistores, por exemplo, surgiu o conceito de barramento de dados, que acelerou a velocidade dos computadores. Ao mesmo tempo apareceram os grandes sistemas operacionais, (simplificadamente, um conjunto de programas mantidos no computador durante todo o tempo, liberando o programador de tarefas relacionadas diretamente com o funcionamento da máquina), como o DOS e OS, da IBM. Estes evoluíram possibilitando novos conceitos que melhoraram a performance das máquinas, como por exemplo os sistemas de multiprogramação, isto é, a possibilidade de vários programas serem executados em paralelo em uma mesma da máquina. Se um destes programas tiver origem em um terminal remoto, tal sistema será chamado de tempo compartilhado. Um importante marco que possibilitou esses avanços foi a introdução de processadores de entrada e saída, também chamados de canais. Isso motivou o aparecimento dos conceitos de concorrência, comunicação e sincronização: uma vez que dois processadores estão operando simultaneamente, surge a necessidade de prover mecanismos para sincronizá-los e estabelecer um canal de comunicação entre eles.

É a era das arquiteturas mainframes: o suporte às tarefas computacionais e o desenvolvimento das aplicações eram feitos numa área central, denominada centro de computação. Terminais conectados diretamente à máquina eram utilizados somente por pessoas relacionadas às aplicações disponíveis.

Nos anos 70 surgiram os supercomputadores, máquinas que inovaram na arquitetura. Até o momento, o crescimento da eficiência dos computadores estava limitado pela tecnologia, mais especificamente pelo processamento escalar que exigia que o processador central de um computador terminasse uma tarefa para começar a realizar outra, produzindo o gargalo de von Neumann. Um avanço significativo veio com o supercomputador Cray-1, da Cray Research, em 1971. Foi a primeira máquina pipeline, cujo processador executava uma instrução dividindo-a em partes, como na linha de montagem de um carro. Enquanto a segunda parte de uma instrução estava sendo processada, a primeira parte de outra instrução começava a ser trabalhada. A evolução seguinte foi a denominada máquina vetorial, ou máquina SIMD (single instruction multiple data) cujo processador trabalhava com mais de um conjunto de dados ao mesmo tempo. Um pouco depois surgiu a arquitetura MIMD (multiple instructions multiple data) e apareceram máquinas com múltiplos processadores como a Connection Machine, com 65.536 processadores.

Há primariamente três limites para a performance dos supercomputadores: a velocidade do processador, o gasto de tempo (o termo técnico, amplamente utilizado na Computação, é overhead), que envolve fazer um grande número de processadores trabalharem juntos em uma única tarefa, e a velocidade de entrada e saída entre os processadores e entre os processadores e a memória. A velocidade dos processadores aumenta a cada dia, mas a um alto custo de pesquisa e desenvolvimento, e a realidade é que se está alcançando os limites dos processadores baseados em silício. Seymour Cray demonstrou que a tecnologia de gálio arsênico poderia ser a solução, mas é muito difícil trabalhar com ele e poucas indústrias estariam aptas a desenvolver processadores desse tipo. A solução, como se falará mais abaixo caminha para o uso de um maior número de processadores, dando maior velocidade ao computador pelo uso desses processadores através do processamento paralelo.

Com a tecnologia VLSI (quarta geração de computadores) surgiram os minicomputadores, o que possibilitou muitas empresas e universidades informatizarem seus departamentos. Os grandes usuários interligavam os minicomputadores para enviar tarefas aos seus mainframes. A arquitetura principal continuava no entanto estabelecida no centro de computação. Do minicomputador para o computador pessoal foi somente um passo, e no início da década de 1980 apareceram os primeiros PC's. Ainda nos anos de 1980 apareceram as arquiteturas RISC (Reduced Instruction Set Code), com a promessa de ganho de desempenho pela eliminação do conceito de microprograma. De qualquer maneira estas máquinas ainda são máquinas de von Neumann tradicionais, com todas as suas limitações, a maior delas a velocidade dos circuitos que não pode crescer indefinidamente.

As tentativas de quebrar o gargalo de von Neumann e o início da descentralização dos sistemas, com o surgimento das arquiteturas de rede que possibilitaram a universalização do uso da tecnologia da Computação, fizeram emergir e desenvolver as arquiteturas paralelas de hardware.

A idéia de incluir paralelismo nos computadores é tão antiga quanto os próprios computadores. Trabalhos desenvolvidos por von Neumann na década de 1940 já discutiam a possibilidade de algoritmos paralelos para a solução de equações diferenciais. O sistema Model V, desenvolvido entre 1944 e 1947 por G. R. Stibitz e S. B. Willians nos laboratórios da Bell Telephone é um exemplo típico de máquina paralela. Constituído por dois processadores e de três posições de entrada e saída, esse multiprocessador primitivo tanto era capaz de executar dois programas distintos como era possível que os dois processadores ficassem alocados para um mesmo programa. Posteriormente foi desenvolvido o Illiac IV, na década de 1960, constituído por 64 processadores. Como foi citado, a partir da década de 1970 começaram a ser produzidos supercomputadores baseados em arquiteturas paralelas.

Juntamente com as arquiteturas evoluiram os sistemas operacionais e a evolução das linhas de processadores de uma empresa como a Intel servem para refletir a evolução da indústria dos computadores em um determinado período. Como destaque podem-se citar o MS-DOS, o OS/2 e o UNIX. Especialmente este último, que surgiu como fruto dos trabalhos de um engenheiro da Bell Labs, Ken Thompson, foi popularizado nos meios universitários que usavam computadores PDP-11/45, durante a década de 1970. A palavra UNIX espalhou-se rapidamente por todo o mundo e no início de 1980 este sistema operacional estava disponível em mais máquinas do que qualquer outro sistema operacional da época, continuando hoje ainda a ser amplamente utilizado.

A mais nova arquitetura, que determinou a mais recente evolução da Computação foi o resultado da rápida convergência das tecnologias de comunicações de dados, telecomunicações e a própria informática. É a Internet, ou modelo computacional baseado em uma rede, que teve sua origem nos anos da década de 1970, como um esforço do Departamento de Defesa dos EUA para conectar a sua rede experimental, chamada ARPAnet, a várias outras redes de rádio e satélites. Espalhou-se logo em seguida nos meios acadêmicos e está bastante popularizada.

Continuarei a publicar mais artigos sobre o inicio da era dos computadores mais a frente.

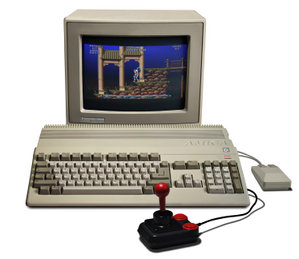

1 – Mainframes

Computadores enormes, trancados em salas refrigeradas e muitos caros, restritos a poucos, em geral grandes empresas e bancos. Esses eram os mainframes, sucesso na década de 70.

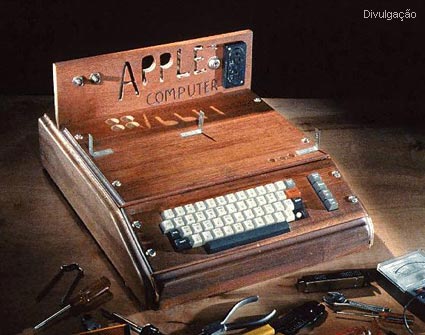

2 – Apple II

Ainda nos anos 70, mais precisamente em 1977, surgia o primeiro microcomputador como conhecemos hoje, o Apple II, com direito a teclado integrado e recurso capaz de gerar gráficos coloridos. Parte da linguagem de programação dele havia sido feita pela Microsoft, uma variação do Basic para o Apple II.

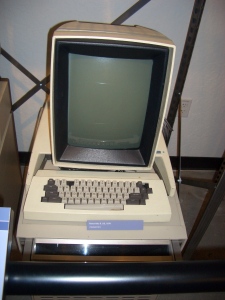

3 – IBM PC

Gigante no mercado de computadores de grande porte (ainda hoje é assim), a IBM queria entrar no mercado da microinformática. Isso ocorreu em 1980, ano em que a Big Blue juntou vários engenheiros para desenvolver um novo produto, o IBM PC. Na época, um sucesso. A brincadeira começava a ficar séria.

4 – Parceria IBM-Microsoft

O IBM PC necessitava de um sistema operacional. A Microsoft dizia ter um, mas, na verdade, não tinham nada pronto. Após fechar contrato de licenciamento do DOS para a IBM, Bill Gates e seu parceiro, o programador Paul Allen, foram atrás da nanica Seatlle Computer e da sua joia, o QDOS. Adquiriram o sistema por irrisórios US$ 50 mil. A Microsoft então adaptou-o e criou o PC-DOS. O contrato com a IBM previa um royalty, entre 10 e 50 dólares por máquina vendida, mais um pequeno pagamento inicial. Só que o sistema continuava sobre propriedade da Microsoft, que podia distribuir versões modificadas (MS-DOS). Baita negócio para Bill Gates. O restante da história todo mundo sabe…

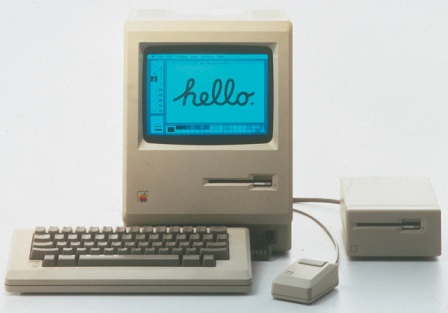

5 – Macintosh

Disposta a manter-se na liderança do mercado de microinformática, a Apple se viu obrigada a criar um produto novo e de fácil operação para o usuário. Em 1979, Jef Raskin, considerado especialista em interfaces homem-máquina, criou as bases do projeto Macintosh. Steve Jobs se interessou e, em janeiro de 1981, tomou a direção do projeto, finalizado com sucesso no início de 1984, deixando a IBM para trás.

6 – Microsoft e a popularização do Windows

Para enfrentar o Mac OS (na época chamado de System 1.0), a Microsoft criou o Windows 1.0, em 1985. Mas foram os seus sucessores, da década de 1990, que fizeram sucesso. A Microsoft, que usufruía de enorme expansão no mercado de PCs, criou duas linhas de sistemas operacionais: uma derivada do Windows 1.0 e do DOS e outra de sistemas operacionais totalmente gráficos e orientados a servidores. O Windows XP, chegou em 2001, unificando as linhas e seu sucessor, o Windows Vista, modificou completamente a interface gráfica. Hoje, a Microsoft trabalha no Windows Server 2008 (para servidores) e no Windows 7, sucessor do Windows Vista, que foi lançado em outubro de 2009.

O ser humano sempre procurou produzir mais com menos esforço e criou as máquinas para a simplificação e a evolução do trabalho humano.

A primeira calculadora que realizava operação de soma e subtração, denominada “La Pasqualini”, foi criada em 1942 pelo francês Blaise Pascal. Essa máquina funcionava por meio de uma engrenagem de rodas dentadas que levava os dígitos de uma coluna à outra. Os resultados eram mostrados uma espécie de janelinha.

Leibniz, sucessor de Pascal, construiu uma máquina bem sofisticada para a época, com avanços práticos. Ela trabalhava por meio de alavancas e relógios.

O matemático inglês Babbage desenvolveu a idéia de um dispositivo de entrada e saída. Essa máquina usava cartões perfurados para receber comandos do meio externo.

Alan Turing desenvolveu o que conhecemos hoje como a base de todas as técnicas de programação, numa forma de inserir dados nas máquinas, chamada de decodificação, As informações eram transformadas em sinais binários, ou seja, zero (0) e um (1). A partir desse momento as maquinas puderam trabalhar com todos os tipos de informações.

A evolução da maquina computador teve a chance de ser testada em um grande evento: o censo estadunidense de 1890. A grande inovação introduzida por Herman Hollerith foi à utilização da eletricidade para por em funcionamento o computador.

O crescente avanço da tecnologia utilizada na criação de máquinas chamou a tenção dos milhares de estadunidenses, que, interessados no poder que essas maquinas poderiam trazar a longo prazo, empregaram vultosos investimentos em pesquisas e projetos sobre o computadores. Durante a 2° guerra mundial. Os militares começaram a ter os primeiros resultados desses investimentos.

O Mark I, uma enorme computador que utilizava milhares de relès, foi desenvolvido pela marinha em parceria com a Universidade de Harvard e a IBM, em 1944. Um dos problemas apresentados pelo Mark I era o ruído alto e intenso que ele emitia quando estava funcionando.

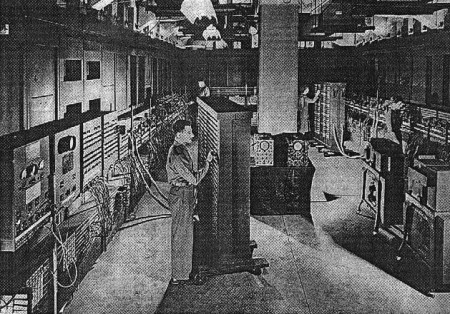

No decorrer da 2° Guerra Mundial, criou-se um novo grande computador, com fins bélicos: o ENIAC o qual sua sigla significou Electronic Numeric Integrator and Calculator. Ele funcionava por meio de um sistema construído inteiramente por válvulas. Esse computador não chegou a ser utilizado, pois ficou pronto somente em 1946, quando a guerra já havia terminado.

Após o ENIAC, foi elaborado o projeto de outro computador, o EDVAC, projetado com programação interna.

Em 1949, os computadores eram usados apenas em projetos governamentais e acadêmicos.

A IBM começou, em 1951, a produzir computadores em série.

Um professor de Princeton, nos Estados Unidos, Von Neumann, criou um sistema de estrutura lógica para o computador, para que pudesse trabalhar com vários tipos de informações ao mesmo tempo.

As idéias de Von Neumann transformaram o mundo da computação. Outro avanço tecnológico foi à criação do transistor, peça eletrônica com materiais semicondutores e com a mesma função das válvulas, porém, mais rápido, maior confiabilidade, eficiência e durabilidade, utilizando menores quantidades de energia, além de esquentar menos que as válvulas.

O transistor possibilitou a redução continua dos custos de produção dos computadores, tornando os computares mais acessíveis.

Com a evolução dos transistores, desenvolveu-se a idéia de criar uma peça com maior poder de processamento de informações: criou-se então o chip em apenas uma peça.

A história da computação modifica-se continuamente, e hoje chegamos a um estágio em que todos os equipamentos acabam se tornando ultrapassados, pois a cada dia cri-se um equipamento novo, mais rápido e com maior poder de processamento.

O ser humano, dotado de sua inteligência, buscou formas, durante toda a história da tecnologia de vencer os obstáculos impostos pela natureza. Desta forma, foi desenvolvendo e inventando instrumentos tecnológicos com o objetivo de superar dificuldades. Podemos dizer que a necessidade é a mãe das grandes invenções tecnológicas.

1440 - Foi criada a tecnologia da impressão por GUTENBERG.

1454 - O alemão Johann Gutenberg. inventa a máquina chamada de Imprensa. Com está máquina o homem passou a produzir de forma mais rápida e eficiente, os livros. Esse invento causou uma revolução na cultura da época.

1590 - O holandês Zacharias Janssen (1580-1638?) fabrica o microscópio, utilizando técnicas usadas na fabricação de lentes para óculos.

1592 - O astrônomo e inventor italiano cria o primeiro termômetro utilizando o sistema de água para a medição de temperatura.

1643 - O cientista italiano Evangelista Torricelli inventa o barômetro para medir a pressão atmosférica.

1707 - O físico inglês John Floyer inventa o relógio de pulso.

1712 - O engenheiro inglês Thomas Newcomen inventa a máquina a vapor.

1800 - O físico italiano Alessandro Volta cria a bateria elétrica.

1822 - Foi produzida a primeira imagem reconhecida como fotografia pelo francês JOSEPH NICÉPHORE NIÉPCE

1839 - O artista e pesquisador francês Louis-Jacques-Mandé Daguerre tira a primeira fotografia, com sua máquina chamada daguerreótipo

1860 - O inventor belga Jean-Joseph-Etienne Lenoir desenvolve o primeiro motor a explosão.

1874 - Foi inventado o rádio

1876 - O americano Alexander Graham Bell inventa o telefone, possibilitando a comunicação entre pessoas situadas a longas distâncias.

1879 - O americano Thomas Alva Edison inventa a lâmpada elétrica.

1895 - Foi criado o cinematógrafo pelos irmãos LUMIÉRE.

1901 - É criado o rádio pelo italiano Guglielmo Marconi.

1903 - Os irmãos Wright pilotam o primeiro avião.

1904 - Criadas pelo engenheiro inglês John Ambrose Fleming surgem as válvulas eletrônicas.

1906 - O brasileiro Alberto Santos Dumont voa em paris no 14 bis e passa também a ser considerado um dos pais da aviação junto com os irmãos Wright.

1941 - O engenheiro inglês Frank Whittle desenvolve o avião a jato.

1943 - A empresa japonesa Motorola lança no mercado o walkie-talkie.

1945 - Os EUA detonam no deserto do Novo México a primeira bomba atômica.

1946 - O engenheiro americano Vannevar Bush desenvolve um computador usando válvulas de rádio.

1947 - A televisão começa a chegar nos lares de pessoas de todo o mundo.

1948 - Começam a ser utilizados os chips de silício e as válvulas eletrônicas.

1956 -O pager é lançado nos Estados Unidos.

1961 - Lançada a Vostok, a primeira nave espacial tripulado por ser humano a sair da atmosfera terrestre.

1965 - Lançados os primeiros satélites de comunicação. Inaugura uma nova era na transmissão de dados eletrônicos.

1972 - Os discos laser são lançados revolucionando a indústria fonográfica.

1977 - Lançado nos Estados Unidos o primeiro telefone celular.

1981 - Primeira viagem de um ônibus espacial.

1995 - Dave Wineland e Chris Monroe desenvolvem o primeiro transistor do tamanho de um átomo.

1998 - Lançado no Brasil os primeiros DVDs.

1999 - A Internet cresce no mundo todo em velocidade impressionante. Os arquivos de MP3 começam a ser usados e transmitidos pelas ondas da

Durante o período conturbado pela Segunda Guerra Mundial – 1939 / 1945 – foi desenvolvida investigação e implantação de projectos de electrónica e computadores das quais uma pequena parte é publicamente conhecida. Só a partir de 1996 a NSA – National Security Agency USA – liberta os denominados “segredos de guerra” e começam a ser conhecidos publicamente fatos que conduzem ao refazer de uma “história oficial” há vários anos repetida e induzida na área da Ciência da Computação. Tradicionalmente a origem dos Computadores electrónicos tem sido atribuída ao ENIAC - Electronic Numerical Integrator and Automatic Computer - construído na Moore Scholl of Electrical Engineering da University of Pensylvania nos USA entre Maio 1943 (31 de Maio de 1943 com contrato assinado em 5 de Junho de 1943

com o USA Army - Ordnance Department; Ballistic Research Laboratory) e Novembro de 1945. O ENIAC foi formalmente apresentado à Imprensa no dia 15 de Fevereiro de 1946 na Moore School of Electrical Engineering. O ENIACfoi entregue oficialmente ao USA Army em 30 de Junho de 1946. Desligado em 9 de Novembro de 1946 arrancou, nas suas novas instalações em Aberdeen - USA -, a 29 de Julho de 1947. Foi utilizado até ao dia 2 de O utubro de 1955, data a partir da qual foi desmantelado e algumas das suas peças foram entregues a Smithsonian Institution em Washington, D.C. para exposição pública. Também tradicionalmente se considera que o ENIAC teria sido concebido por John von Neumann e construído segundo a denominada Arquitectura von Neumann.

História da tecnologia

John Napier nasceu em 1550 e morreu em 1617, escocês inventor dos logaritmos, também inventou o Napier, que eram tabelas de multiplicação gravadas em bastão, o que evitava a memorização da tabuada.

A primeira máquina de verdade foi construída por Wilhelm Schickard nasceu em 1592 e morreu em 1635, sendo capaz de somar, subtrair, multiplicar e dividir. Essa máquina foi perdida durante a guerra dos trinta anos, sendo que recentemente foi encontrada alguma documentação sobre ela. Durante muitos anos nada se soube sobre essa máquina, por isso, atribuía-se a Blaise Pascal nasceu em 1623 e morreu em 1662 a construção da primeira máquina calculadora, que fazia apenas somas e subtrações.

A máquina Pascal foi criada com objetivo de ajudar seu pai a computar os impostos em Rouen, França. O projeto de Pascal foi bastante aprimorado pelo matemático alemão Gottfried Wilhelm Leibniz nasceu em 1646 e morreu 1726, que também inventou o cálculo, o qual sonhou que, um dia no futuro, todo o raciocínio pudesse ser substituído pelo girar de uma simples alavanca.

Todas essas máquinas, porém, estavam longe de ser um computador de uso geral, pois não eram programáveis. Isto quer dizer que a entrada era feita apenas de números, mas não de instruções a respeito do que fazer com os números.

História da tecnologia: Charles Babbage

A História da tecnologia tem muito a ver com a origem da idéia de programar uma máquina e vem da necessidade de que as máquinas de tecer produzissem padrões de cores diferentes. Assim, no século XVIII foi criada uma forma de representar os padrões em cartões de papel perfurado, que eram tratados manualmente, Joseph Marie Jacquard nasceu em 1752 e morreu em 1834 ele inventa um tear mecânico, com uma leitora automática de cartões.

Calculador Diferencial criado por Charles Babbage

A ideia de Jacquard atravessou o Canal da Mancha, onde inspirou Charles Babbage que nasceu em 1792 e morreu em 1871, um professor de matemática de Cambridge, a desenvolver uma máquina de “tecer números”, uma máquina de calcular onde a forma de calcular pudesse ser controlada por cartões.

Tudo começou com a tentativa de desenvolver uma máquina capaz de calcular polinômios por meio de diferenças, o calculador diferencial. Enquanto projetava seu calculador diferencial, a idéia de Jacquard fez com que Babbage imaginasse uma nova e mais complexa máquina, o calculador analítico, extremamente semelhante ao computador atual.

Sua parte principal seria um conjunto de rodas dentadas, o moinho, formando uma máquina de somar com precisão de cinquenta dígitos. As instruções seriam lidas de cartões perfurados. Os cartões seriam lidos em um dispositivo de entrada e armazenados, para futuras referências, em um banco de mil registradores. Cada um dos registradores seria capaz de armazenar um número de cinquenta dígitos, que poderiam ser colocados lá por meio de cartões a partir do resultado de um dos cálculos do moinho.

Além disso tudo, Charles Babbage imaginou a primeira máquina de impressão, que imprimiria os resultados dos cálculos, contidos nos registradores. Charles Babbage conseguiu, durante algum tempo, fundos para sua pesquisa, porém não conseguiu completar sua máquina no tempo prometido e não recebeu mais dinheiro. Hoje, partes de sua máquina podem ser vistas no Museu Britânico, que também construiu uma versão completa, utilizando as técnicas disponíveis na época.

Junto com Charles Babbage, trabalhou a jovem Ada Augusta, filha do poeta Lord Byron, conhecida como Lady Lovelace e Ada Lovelace. Ada foi a primeira programadora da história, projetando e explicando, a pedido de Babbage, programas para a máquina inexistente. Ada inventou os conceitos de subrotina, uma seqüência de instruções que pode ser usada várias vezes, loop, uma instrução que permite a repetição de uma seqüência de cartões, e do salto condicional, que permite saltar algum cartão caso uma condição seja satisfeita.

Ada Lovelace e Charles Babbage estavam avançados demais para o seu tempo, tanto que até a década de 1940, nada se inventou parecido com seu computador analítico. Até essa época foram construídas muitas máquinas mecânicas de somar destinadas a controlar negócios (principalmente caixas registradoras) e algumas máquinas inspiradas na calculadora diferencial de Babbage, para realizar cálculos de engenharia (que não alcançaram grande sucesso).

História da tecnologia: A máquina de tabular

O próximo avanço dos computadores foi feito pelo americano Herman Hollerith nasceu em 1860 morreu em 1929, que inventou uma máquina capaz de processar dados baseada na separação de cartões perfurados (pelos seus furos). A máquina de Hollerith foi utilizada para auxiliar no censo de 1890, reduzindo o tempo de processamento de dados de sete anos, do censo anterior, para apenas dois anos e meio. Ela foi também pioneira ao utilizar a eletricidade na separação, contagem e tabulação dos cartões.

A empresa fundada por Hollerith é hoje conhecida como International Business Machines, ou IBM.

História da tecnologia: Os primeiros computadores de uso geral

O primeiro computador eletro-mecânico foi construído por Konrad Zuse nasceu em 1910 e morreu em 1995. Em 1936, esse engenheiro alemão construiu, a partir de relês que executavam os cálculos e dados lidos em fitas perfuradas, o Z1. Zuse tentou vender o computador ao governo alemão, que desprezou a oferta, já que não poderia auxiliar no esforço de guerra. Os projetos de Zuse ficariam parados durante a guerra, dando a chance aos americanos de desenvolver seus computadores.

O primeiro computador eletro-mecânico foi construído por Konrad Zuse o Z1

O primeiro computador eletro-mecânico foi construído por Konrad Zuse o Z1

Foi na Segunda Guerra Mundial que realmente nasceram os computadores atuais. A Marinha americana, em conjunto com a Universidade de Harvard, desenvolveu o computador Harvard Mark I, projetado pelo professor Howard Aiken, com base no calculador analítico de Babbage. O Mark I ocupava 120m³ aproximadamente, conseguindo multiplicar dois números de dez dígitos em três segundos.

Simultaneamente, e em segredo, o Exército Americano desenvolvia um projeto semelhante, chefiado pelos engenheiros J. Presper Eckert e John Mauchy, cujo resultado foi o primeiro computador a válvulas, o Eletronic Numeric Integrator And Calculator ENIAC, capaz de fazer quinhentas multiplicações por segundo. Tendo sido projetado para calcular trajetórias balísticas, o ENIAC foi mantido em segredo pelo governo americano até o final da guerra, quando foi anunciado ao mundo.

ENIAC, computador desenvolvido pelo Exército Americano.

No ENIAC, o programa era feito rearranjando a fiação em um painel. Nesse ponto John von Neumann propôs a idéia que transformou os calculadores eletrônicos em “cérebros eletrônicos”: modelar a arquitetura do computador segundo o sistema nervoso central. Para isso, eles teriam que ter três características:

- Codificar as instruções de uma forma possível de ser armazenada na memória do computador. Von Neumann sugeriu que fossem usados uns e zeros.

- Armazenar as instruções na memória, bem como toda e qualquer informação necessária a execução da tarefa, e

- Quando processar o programa, buscar as instruções diretamente na memória, ao invés de lerem um novo cartão perfurado a cada passo.

Para divulgar essa idéia, von Neumann publicou sozinho um artigo. Eckert e Mauchy não ficaram muito contentes com isso, pois teriam discutido muitas vezes com ele. O projeto ENIAC acabou se dissolvendo em uma chuva de processos, mas já estava criado o computador moderno.

História da tecnologia: O primeiro Computador digital

O Atanasoff-Berry Computer computador eletrônico foi o primeiro do mundo digital. Foi construído por John Vincent Atanasoff e Clifford Berry em Iowa State University, durante 1937-42. Ela integra diversas inovações importantes em computação, incluindo o uso de aritmética binária, memória regenerativa processamento paralelo, ea separação das funções de memória e de computação.

História da tecnologia: Quebrar um código alemão, o Enigma

Em 1938, Turing publicou um artigo intitulado Sobre matemática computacional Números no qual ele apresentou a teoria do chamado Universal Turing Machines, dispositivos mecânicos capaz de ser configurado a fim de resolver qualquer problema matemático imagináveis. Turing usou este conceito engenhoso para criar precisamente configurável grandes máquinas chamadas "bombas", capaz de aplicar a enorme quantidade de esforço matemático necessário para quebrar o código Enigma pela força bruta.

História da tecnologia: Primeiro programa totalmente automático

Konrad Zuse foi o criador do primeiro programa totalmente automático, controlado e livremente programáveis, em aritmética de ponto flutuante binário de trabalho do computador. O Z3 foi terminado em 1941 Primeiro programa totalmente automático O Z3

Primeiro programa totalmente automático O Z3História da tecnologia: Computador totalmente eléctrico (Colossus)

Colossus reduziu o tempo para de semanas para horas. Foi apenas o tempo para a decifração das mensagens que deu a informação vital para Eisenhower e Montgomery antes do Dia-D. Estas mensagens decifradas mostrou que Hitler tinha engolido as campanhas de artifício, o exército fantasma no sul da Inglaterra, os comboios fantasma que se deslocam para leste ao longo do canal; que Hitler estava convencido de que os ataques foram chegando em todo o Pas de Calais, e que ele mantinha divisões Panzer na Bélgica. Depois do dia D da resistência francesa e britânica e americana a Força Aérea bombardeiam e destroem todas as linhas de telefone e de telex no norte da França, obrigou os alemães a utilizar comunicações de rádio e de repente o volume de mensagens interceptadas subiu rapidamente.

Computador totalmente eléctrico (Colossus)

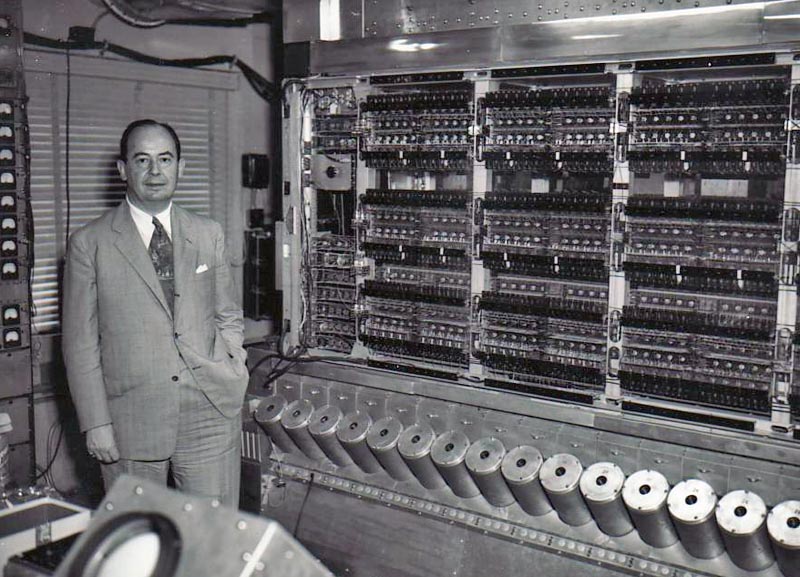

Computador totalmente eléctrico (Colossus) História da tecnologia: Operações de programa armazenado

O Interesse de Von Neumann em computadores diferentes existi por perceber rapidamente a aplicação de computadores para a matemática aplicada, para problemas específicos, em vez da sua mera aplicação para o desenvolvimento de tabelas. Durante a guerra, a perícia de Von Neumann na hidrodinâmica, balística, meteorologia, teoria dos jogos, e estatísticas, foi usada em vários projetos. Este trabalho levou a considerar o uso de dispositivos mecânicos de cálculo, e, embora as histórias sobre Von Neumann implica que seu encontro com o primeiro computador foi o ENIAC, na verdade ele estava com Howard Aiken em Harvard Mark I (ASCC) calculadora.

Von Neumann

Von NeumannHistória da tecnologia: Computador baseado em reles Mark 1

O Mark I foi construído a partir de comutadores, relés, eixos de rotação e embreagens, e foi descrito como soar como uma sala cheia "de senhoras tricotando". A máquina continha mais de 750.000 componentes, foi de 50 metros de comprimento, 8 metros de altura e pesava cerca de 5 toneladas!

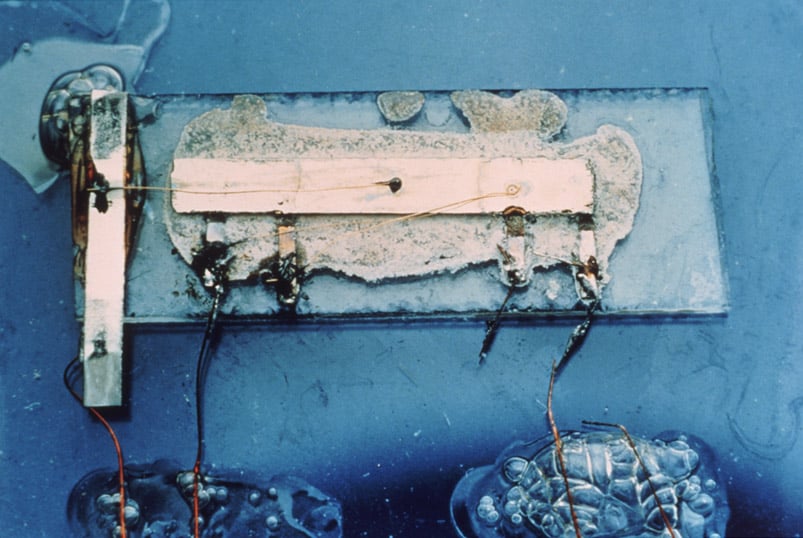

História da tecnologia: Transistor

William Shockley e Walter Brattain ambos tinham sido trabalhar com semicondutores desde o início dos anos 1930, e em 1939, Shockley teve uma idéia, para usar um pedaço de tela de cobre em um pedaço de material semicondutor. Embora esse experimento em particular tenha fracassado, em 1940, Russell Ohl acidentalmente descobre a junção PN de silício no Bell Labs.

Transistor

História da tecnologia: Computador UNIVAC 1

O primeiro computador UNIVAC foi entregue ao Censo em junho de 1951. Ao contrário do ENIAC, o UNIVAC processado cada dígito em série. Mas a sua velocidade muito maior que lhe permitiu somar dois números de dez dígitos, a uma taxa de quase 100.000 adições por segundo. Internamente, o UNIVAC operado a uma freqüência de clock de 2,25 MHz, que não foi tarefa fácil para os circuitos de tubos de vácuo. O UNIVAC empregado também demora mercúrio memórias linha. Linhas de atraso não permitir que o computador para acessar imediatamente qualquer item de dados, realizada em sua memória, mas dada a problemas de confiabilidade da alternativa tubo de raios catódicos (CRT) de tecnologia, esta era uma boa opção técnica.

Computador UNIVAC 1

Computador UNIVAC 1História da tecnologia: Computador transistorizados

Tom Watson, Jr., levou a IBM introduzir o modelo de computadores 604, o primeiro com transistores, que se tornou a base do modelo 608, de 1957, é o primeiro computador sólido para o mercado comercial. Transistores eram caros por serem recem inventados, em primeiro momento, custou US $ 8 vs 75dólarespara um tubo de vácuo.

Computador 604 IBM

Computador 604 IBM

História da tecnologia: TRADIC um computador totalmente transistorizado

TRADIC representa TRAnisitor Digital Computer, e como o nome sugere, esta foi a primeira máquina a utilizar todos os transistores e diodos e não tubos de vácuo. Foi construído pela Bell Labs para a força aerea dos Estados Unidos, que estava interessado na natureza leve, como um computador para utilização aeronáutica. A máquina consistia de 700 pontos de contato com transistores e diodos de germânio 10.000. Durante dois anos de funcionamento contínuo, somente 17 destes dispositivos falharam, uma taxa de insucesso muito menor do que máquinas de tubo de vácuo do tempo.

História da tecnologia: Circuito integrado

Era um aparelho relativamente simples que Jack Kilby mostrou a um grupo de colegas de trabalho, se reuniram no laboratório de TI de semicondutores há mais de 40 anos - apenas um transistor e outros componentes em uma fatia de germânio. Mal sabia este grupo de curiosos que a invenção de Kilby, 7/16-by-1/16 é chamado de circuito integrado, eles estavam prestes a revolucionar a indústria eletrônica.

Circuito integrado Kilby, 7/16-by-1/16

Circuito integrado Kilby, 7/16-by-1/16Historia da tecnologia: Modem

Inventado pela Bell Labs, os esforços de desenvolvimento dos primeiros modems digitais parecem ter se originado a partir da necessidade de transmitir dados para a defesa aérea norte-americana durante a década de 1950.

História da tecnologia

Em 1943 durante a II guerra mindial foi desenvolvido o ENIAC que pesava 30 toneladas e tinha 5;5 metros de altura,25 metros de comprimento e 70 mil resistores e 17.468 válvulas.

A história da tecnologia começou a ganhar forma com o primeiro computador digital eletrônico de grande escala: o ENIAC (Electrical Numerical Integrator and Calculator). O computador foi criado em fevereiro de 1946 pelos cientistas norte-americanos John Presper Eckert e John W. Mauchly, da Electronic Control Company.

Na época, o ENIAC se destacou por realizar 5 mil operações por segundo, velocidade mil vezes superior à de seus antecessores. Hoje, se comparado com os computadores atuais, o poder de processamento do ENIAC seria menor do que o de uma simples calculadora de bolso. O computador começou a ser feito em 1943, durante a Segunda Guerra Mundial, para auxiliar o exército norte-americano a fazer cálculos de balística. O computador pesava 30 toneladas e ocupava 180 m² de área construída.

ENIAC (Electronic Numerical Integrator and Computer), uma concepçao do Professor John Mauchly, conjuntamente com o professor J. Presper Eckert.

Mauchly e o Eckert propuseram em 1943 ao exército norte-americano, em plena II Guerra Mundial, a construçao deste primeiro computador, tendo como objectivo o auxilio nos cálculos de precisao necessários para a balística. Foi anunciada a sua conclusao em 14 de Fevereiro de 1946 e foi patenteado em 26 de Junho de 1947 com o registo n.o 3,120,606.

O ENIAC (Electronic Numerical Integrator and Computer) preenchia esta sala, incomparável com os miniaturizados e mais potentes computadores actuais.

J. Presper Eckert, Jr.; Professor J. G. Brainerd; Sam Feltman; Captain H. H. Goldstine; Dr. J. W. Mauchly; Dean Harold Pender; General G. M. Barnes; Colonel Paul N. Gillon.

O ENIAC era uma grande máquina para efectuar cálculos e baseava a sua estrutura nos avanços científicos já anteriormente desenvolvidos, como as sofisticadas máquinas de cálculos matemáticos de Charles Babage, as calculadoras mecânicas de Blaise Pascal, Leibniz e Charles Xavier Thomas, nas relés electromagnéticas, nas válvulas e nas máquinas perfuradoras de cartoes. Uma válvula é, de forma simples, um tubo metálico de meia polegada, selado em vácuo dentro de um tubo de vidro, onde uma corrente de electroes pode passar entre os eléctrodos. Os tubos de vácuo foram fundamentais para o desenvolvimento da rádio, televisao e gravaçao de sons. Eram também peças grandes e muito frágeis que tinham uma grande perda de energia por calor.

O ENIAC pesava 30 toneladas, consumia 200 000 watts de potencia e ocupava várias salas. Quando em operaçao produzia tanto calor que necessitava de um sistema de ar forçado para arrefecimento. Era tao grande que tinha de ser disposto em U com tres painéis sobre rodas, para que os operadores se pudessem mover a volta dele.

Quando em operaçao, os complexos cálculos de balística passaram a realizar–se nuns alucinantes 30 segundos, quando com as calculadoras manuais que até aí se usavam demorava12 horas até se obter o mesmo resultado.

O centro de processamento tinha uma estrutura muito simular a dos processadores mais básicos que actualmente utilizamos nas nossas calculadoras de bolso. Tinha 20 registos de dez dígitos cada, onde se podiam efectuar somas, subtracçoes, multiplicaçoes, divisoes e raízes quadradas.

O ENIAC era programado através de milhares de interruptores, podendo cada um dele assumir o valor 1 ou 0 consoante o interruptor estava ligado ou desligado.

Para o programar era necessário uma grande quantidade de pessoas que percorriam as longas filas de interruptores dando ao ENIAC as instruçoes necessárias para computar, ou seja, calcular.

Existia uma equipa de 80 mulheres na Universidade da Pensilvânia cuja funçao era calcular manualmente as equaçoes diferenciais necessárias para os cálculos de balística. O exército chamava a funçao destas pessoas: computadores.

Quando o ENIAC ficou pronto 6 mulheres computador foram escolhidas para testarem a nova máquina.

Curiosamente, o termo deixou de estar associado as pessoas que operavam a máquina para dar nome a máquina propriamente dita, uma vez que de facto a máquina passou a realizar as contas que antes eram realizadas por essas pessoas.

O ENIAC torna-se obsoleto e economicamente inviável de manter após 10 anos de operaçao, tendo sido desmontado. Hoje encontram-se peças do ENIAC por muitos museus do mundo, incluindo o Smithsonian em Washington D.C. e no local preciso onde foi construído, na Moore School for Electrical Engineering da Universidade da Pensilvânia.